L’intelligenza artificiale (IA) è considerata a ragione una tecnologia strategica per la crescita economica, l’innovazione industriale e il raggiungimento dei più alti livelli di competitività delle imprese sui mercati globali. Prova ne è la crescente spesa, a livello europeo e globale, in questo tipo di soluzioni.

L’Europa vuole un posto di leadership nel settore, ma deve prima trovare un approccio comune di tutti i suoi Stati all’implementazione dell’IA ad ogni livello, con norme e limiti di ordine etico, regolatorio e finanziario, ma anche culturale e relativi a privacy e sicurezza.

Approccio etico dell’Europa all’IA

A riguardo, la Commissione europea proporrà entro l’anno in corso un pacchetto di regole per l’intelligenza artificiale, mirato a salvaguardare i valori etici e i diritti fondamentali dell’essere umano, quindi teso a stabilire i requisiti di sicurezza ed affidabilità di questa tecnologia.

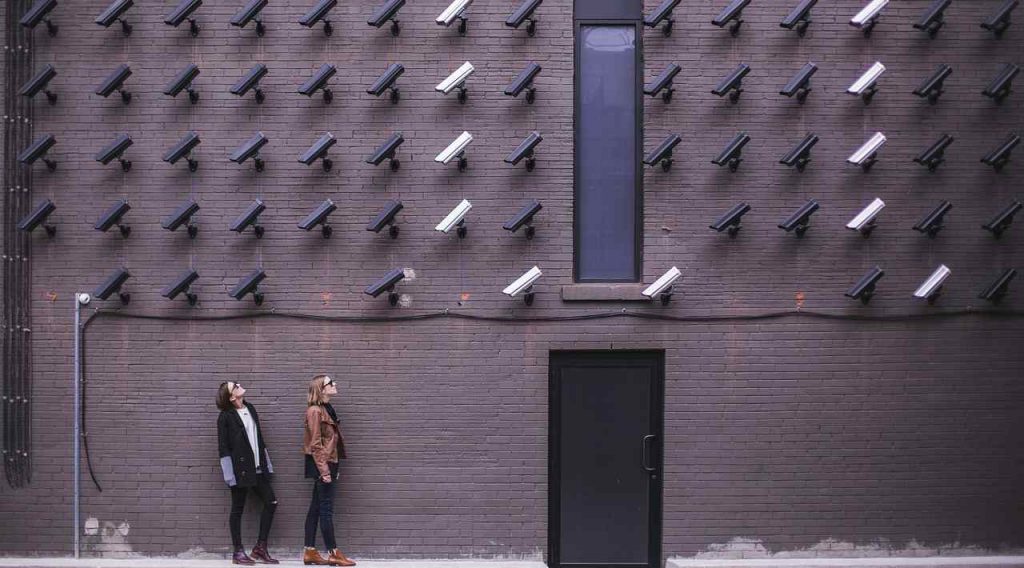

Nella bozza di documento “European approach for artificial intelligence”, visionato in anteprima da euractive.com, si manifesta la volontà della Commissione di vietare l’utilizzo di sistemi IA per le operazioni di sorveglianza indiscriminata dei cittadini.

Entro la prossima settimana, si legge sul sito, saranno proposti nuovi criteri e parametri per l’utilizzo dell’IA in questo tipo di operazioni. Tra i diversi metodi di sorveglianza sono citati quelli che includono il monitoraggio e il tracciamento delle persone fisiche, sia in ambiti tradizionali, sia digitali, ma anche l’aggregazione e l’analisi automatizzate di dati personali provenienti da varie fonti.

Divieti e sanzioni, le deroghe per la sicurezza nazionale

Ulteriori divieti saranno proposti per ogni uso dell’intelligenza artificiale che violi i valori di base dell’Unione e i diritti umani più in generale.

Si pensa di estendere il divieto di utilizzo dell’IA anche a quel tipo di sorveglianza tesa a manipolare, controllare o limitare il comportamento e la libertà di spostamento degli esseri umani, soprattutto a vantaggio di terzi.

In termini di sanzioni, potrebbero essere previste multe fino al 4% del fatturato annuo globale di un’azienda che non rispetti tali divieti.

Nel documento è però precisato che in caso di motivi di sicurezza nazionale tali divieti non varranno per i Governi e le Autorità pubbliche che impiegheranno l’IA anche nei modi sopra descritti.

Questo significa che gli Stati europei potrebbero in futuro impiegare l’intelligenza artificiale anche per la sorveglianza di massa o il tracciamento dei nostri dati, se per comprovati motivi di sicurezza interna.

Applicazioni IA ad alto rischio

Altre applicazioni IA ad alto rischio sono l’identificazione biometrica remota di ignari cittadini in spazi accessibili al pubblico, tra cui il riconoscimento facciale, l’integrazione nelle infrastrutture pubbliche strategiche, come quelle relative ai trasporti, alla fornitura di acqua ed energia, la Difesa.

Per tutti questi motivi, la Commissione propone l’istituzione di un Board europeo per l’intelligenza artificiale, composto da 27 rappresentanti degli Stati membri, dal Garante europeo per la protezione dei dati e da un rappresentate della Commissione europea.

La proposta, infine, dovrebbe essere presentata ufficialmente dal Vice Presidente esecutivo per il digitale della Commissione europea, Margrethe Vestager, il prossimo 21 aprile. Seguirà il parere del Consiglio e il voto del Parlamento europeo.