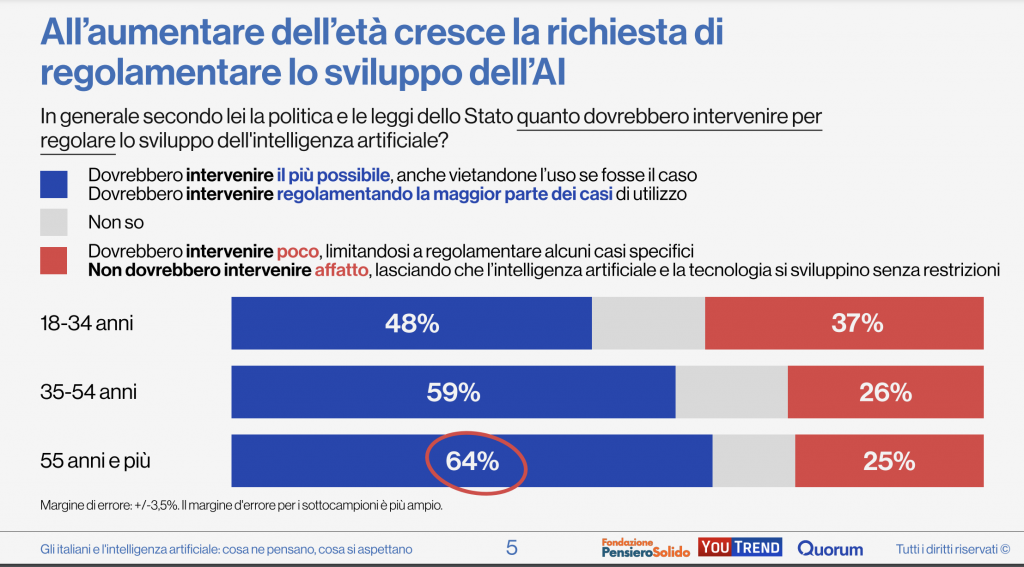

Intelligenza artificiale e regole. Tre italiani su cinque pensano che la politica e le leggi dello Stato dovrebbero intervenire il più possibile, anche vietandone l’uso se fosse il caso, o comunque regolamentando la maggior parte dei casi di utilizzo.

Lo rivela un sondaggio condotto da YouTrend per la Fondazione Pensiero Solido, disponibile qui.

IA, Italiani sfiduciosi. Per il 51% porterà la perdita di posti di lavoro

Sul fronte occupazionale, secondo l’indagine, tra gli italiani prevale in generale la percezione che questa tecnologia porterà ad un calo complessivo dei posti di lavoro: la pensa così il 51% degli intervistati, mentre per il 10% l’occupazione aumenterà e per il 26% i posti di lavoro resteranno più o meno gli stessi anche se cambieranno le mansioni.

La maggioranza degli occupati (55%) non sarebbe inoltre disposta a farsi dare volentieri istruzioni dall’intelligenza artificiale sul lavoro (mentre il 37% sì), sebbene il controllo e la valutazione automatica siano comunque percepiti più come un vantaggio (47%) che come uno svantaggio (30%), e questa percezione di vantaggio aumenta soprattutto tra i giovani e i laureati.

I lavori percepiti come più sostituibili da un’intelligenza artificiale sono quelli svolti da impiegati (56%), operai (51%) e commessi (43%), ossia mansioni che non richiedono titoli di studio elevati, mentre all’opposto quelli che vengono percepiti come meno sostituibili da un’intelligenza artificiale sono l’artista (24%), l’imprenditore (26%) e il medico (27%). Solo una minoranza degli occupati si sente aiutata (23%) o all’opposto minacciata (21%) dai cambiamenti portati da queste nuove tecnologie, mentre la maggioranza (50%) non si sente né aiutata né minacciata.

Il fondatore di ChatGPT: “L’IA va regolamentata, se non controllate è un rischio per l’umanità’

Anche Sam Altman, fondatore di OpenAI, chiede esplicitamente regole severissime per l’intelligenza artificiale generativa. “La mia più grande paura è che il campo dell’IA possa fare davvero del male al mondo. Se questa tecnologia prende la direzione sbagliata, diventa veramente sbagliata”, ha dichiarato Altman due giorni fa al Senato americano dove è stato ascoltato per quasi tre ore.

L’impatto sulle elezioni, a cominciare dalle presidenziali americane del 2024, ha ammesso, “è un’area di grande preoccupazione. Il rischio, ha aggiunto, è che possano essere prodotte notizie false per avvelenare il dibattito, influenzare le masse, ma su questo ha detto che stanno lavorando per limitare il rischio. È cruciale che l’Intelligenza artificiale venga sviluppata con valori democratici. Penso, ha insistito, che abbiamo anche bisogno di regole, linee guida. Questa cosa mi toglie serenità”.

Altman ha detto di voler lavorare con il governo per prevenire un uso distorto, pensa a organismi esterni ma non ha promesso di rallentare il processo di ricerca, come chiedevano molti scienziati.

“Gli Stati Uniti, ha sottolineato, dovrebbero considerare la possibilità di dare licenze per sviluppare modelli di Intelligenza artificiale, ma anche di ritirarle per evitare che finiscano in mano alle persone sbagliate”. Il Ceo ha invocato una regolamentazione a livello mondiale, suggerito che sarebbe utile immaginare una gestione come è stato fatto con gli armamenti nucleari. Servirebbe, ha fatto capire, un organismo tipo l’International Atomic Energy Agency, ma applicato ai robot.